Google Gemini 2.5, Project Astra та Beam: повний огляд Google I/O 2025

Google щойно показав майбутнє — і воно прийшло на 10 років раніше, ніж ми очікували.

За рік кількість токенів, які обробляє Google, зросла з 9,7 трильйонів до 480 трильйонів на місяць — це у 50 разів більше. Додаток Gemini тепер має понад 400 мільйонів активних користувачів щомісяця. Але цифри — це лише верхівка айсберга.

За дві години презентації Google анонсував десятки технологій, які змінюють правила гри у сферах від пошуку до створення відео. AI Overviews тепер доступні у понад 200 країнах і територіях. Компанія запустила підписку за $250 на місяць для тих, хто хоче доступ до найпотужніших AI-моделей.

Найцікавіше — більшість анонсованого доступно вже зараз. Не "скоро", не "в наступному році". Сьогодні.

Чому це важливо? Тому що Google змінює стратегію. Замість поступових поліпшень компанія робить кардинальні стрибки. Замість захисту старих технологій — винаходить нові категорії продуктів. І робить це зі швидкістю, яка змушує конкурентів бігти на повну.

Голографічне спілкування

Забудьте про плоскі відеодзвінки з поганим звуком і пікселізованою картинкою. Google Beam перетворює звичайний відеодзвінок у майже голографічне спілкування, де ви бачите співрозмовника в тривимірному просторі.

Шість камер фіксують співрозмовника з усіх сторін, а AI об'єднує потоки в тривимірне зображення з точністю відстеження рухів до міліметра і частотою 60 кадрів у секунду. Це не просто покращення якості — це принципово новий спосіб спілкування.

Технологія працює так: камери знімають вас з різних ракурсів, штучний інтелект аналізує всі відеопотоки і відображає тривимірну модель на спеціальному дисплеї. Результат — співрозмовник ніби сидить навпроти, а не дивиться з екрана.

Найбільше вражає швидкість. Відстеження рухів голови відбувається з точністю до міліметра і частотою 60 кадрів у секунду, і все це в режимі реального часу. Жодних затримок чи гальмувань — природне спілкування, як при особистій зустрічі.

Google каже відверто: якщо технологія приживеться, класичні вебкамери стануть анахронізмом так же швидко, як кнопкові телефони після появи смартфонів. Амбітне порівняння, але логічне. Коли ти спілкуєшся з тривимірною проєкцією людини, повертатися до плоского відео не хочеться.

Перші пристрої під маркою Google Beam з'являться у пілотних клієнтів вже до кінця року. Випуском займеться HP. Це означає, що технологія не просто концепт — вона готова до комерціалізації.

Єдиний нюанс: обидва співрозмовники повинні сидіти в спеціальних кабінах, які можуть генерувати тривимірні рендери. Поки що це обмежує використання офісами та спеціальними локаціями. Але початок покладено.

Для віддаленої роботи це переломний момент. Зустрічі з колегами з інших країн стануть майже такими ж природними, як особисті. А для бізнесу, який витрачає мільйони на відрядження, Beam може стати серйозною альтернативою.

Миттєвий переклад без пауз

Уявіть дзвінок, де американець говорить англійською, іспанець відповідає рідною мовою, а всі розуміють один одного без затримок і незручних пауз. Google зробив це реальністю.

Нова функція VideoStreach у Google Meet використовує потужну аудіомодель Google DeepMind і перетворює розмову людей, що говорять різними мовами, на безперервний діалог. Переклад йде в реальному часі, але найвражаюче — зберігаються оригінальні інтонації, тембр голосу та емоційні відтінки.

Раніше такої швидкості досягти не вдавалося. Коли співрозмовник говорить, його справжній голос все ще ледве помітно чутний, а поверх накладається перекладена доріжка зі збереженням манери мовлення та навіть виразу обличчя.

Це відкриває масу сценаріїв. Міжнародні команди можуть обговорювати робочі питання без страху мовного бар'єра. До розмови може одночасно підключатися кілька людей — затримки при перекладі мінімальні.

У корпоративному сегменті Google вже готує ранні випробування. Клієнти Workspace отримають доступ до системи до кінця року. Це означає, що до новорічних свят міжнародний бізнес зможе спілкуватися принципово по-новому.

Технологія може змінити освіту, дипломатію, медицину — всі сфери, де важливе точне розуміння між людьми з різних країн. І все це без вивчення мов чи найму перекладачів.

Project Astra

Наведіть камеру смартфона на велосипед із проблемою — і AI-асистент миттєво пояснить, як його полагодити. Покажіть рукописний список справ — асистент розпише план дня. Це не фантастика, а Project Astra, який Google запускає прямо зараз.

Project Astra — це очі та вуха майбутнього універсального асистента. Камера смартфона транслює зображення в модель Gemini Live, і та розуміє, що бачить користувач. Головна особливість — латентність у десятки мілісекунд. Система не перериває природної розмови, ви ставите питання й отримуєте відповідь швидше, ніж встигаєте моргнути.

Це принципово новий рівень взаємодії з технологіями. AI стає не просто інструментом пошуку, а активним помічником, який бачить проблему і допомагає її вирішити покроково.

Функції реального часу від Project Astra надходять до AI Mode в Labs. Search Live у Google Search тепер дозволяє включити AI-режим або камеру Lens, натиснути кнопку Live і ставити питання про те, що знаходиться перед об'єктивом смартфона.

Вперше Astra показали рік тому на концепт-окулярах, які миттєво стали вірусними. Тоді розробники пообіцяли пристрій, що дозволяє бачити світ з підказками. Зараз Google підтверджує — окуляри створюються спільно з Samsung та Warby Parker, але терміни реалізації все ще туманні.

Зате самі технології Astra вже впроваджуються в продукти, доступні звичайним користувачам. Відсьогодні функція камери та демонстрації екрана запускається для користувачів Android і iOS.

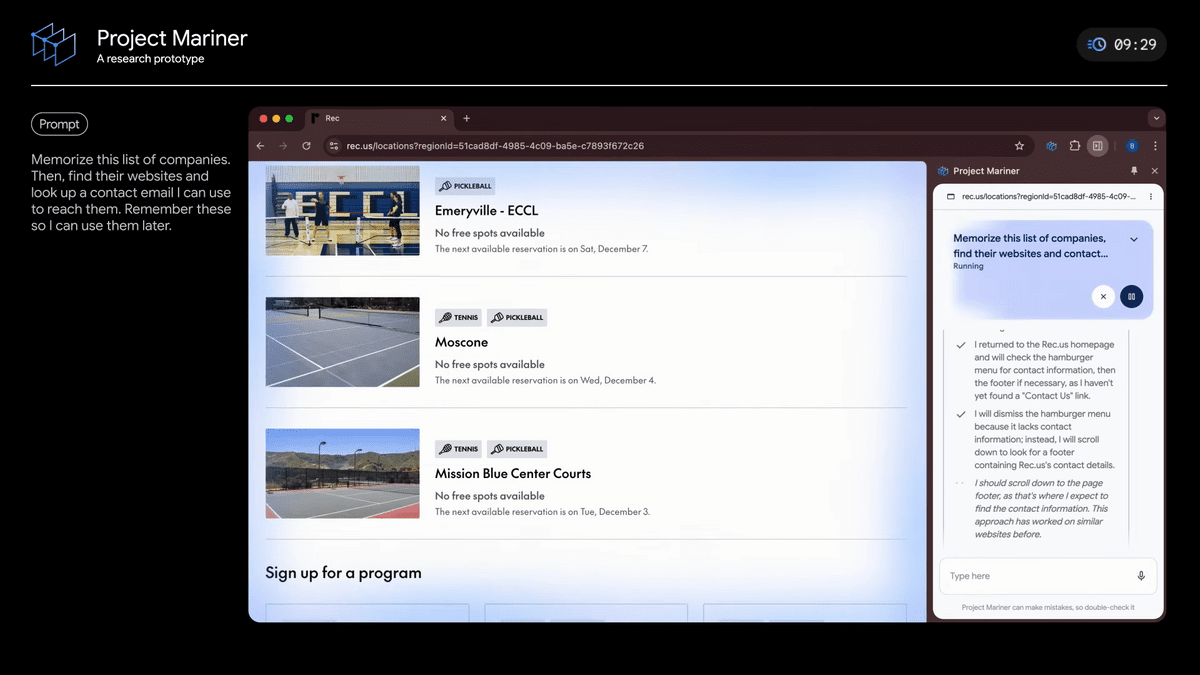

Project Mariner

Забудьте про монотонне заповнення форм і пошук квартир на десятках сайтів. Project Mariner — це браузерний агент, який виконує до 10 задач паралельно, а ви просто чекаєте результат.

Mariner відкриває зовсім новий рівень автоматизації. Він уміє заповнювати форми, фільтрувати результати, повторювати дії, які показав користувач, і навіть навчатися з одного прикладу. Показали йому задачу раз — він запам'ятає план для схожих завдань на майбутнє.

Mariner базується на принципі "навчи та повтори". Ви показуєте завдання один раз, і система запам'ятовує алгоритм для схожих ситуацій. Це кардинально відрізняється від звичайних ботів, які виконують лише заздалегідь запрограмовані дії.

Технологія вже доступна розробникам через Gemini API. Компанії з автоматизації почали її використовувати, а цього літа вона стане доступною ширшому колу користувачів.

Google розглядає використання комп'ютера як частину ширшого набору інструментів для розвитку екосистеми агентів. Компанія запустила протокол взаємодії між агентами, щоб вони могли спілкуватися один з одним, і підтримала протокол контекстного моделювання від Anthropic.

Найцікавіше — кількість паралельних задач. Mariner може контролювати до 10 завдань одночасно, що означає справжню багатозадачність. Поки він шукає квартиру, може паралельно замовляти їжу, бронювати столик у ресторані та купувати квитки на концерт.

Експериментальна версія режиму агента в додатку Gemini скоро з'явиться у підписників. Це означає, що найближчими місяцями мільйони людей зможуть делегувати рутинні онлайн-задачі штучному інтелекту.

Персоналізація через контекст

Google запускає функцію, яка може здатися трохи моторошною і водночас неймовірно корисною. Персональний контекст дозволяє AI переглядати ваші листи, нотатки та документи, щоб генерувати відповіді у вашому стилі та з урахуванням особистого досвіду.

На демонстрації показали, як це працює. Друг написав листа з проханням порадити щось про подорож до Юти, згадавши, що автор уже там був. Зазвичай відповідь була б короткою і не дуже корисною. Але з персоналізованими розумними відповідями все інакше.

Gemini переглядає нотатки та електронні листи, шукає бронювання, знаходить маршрут у Google Docs про поїздку до Національного парку Зайон. Система аналізує типові привітання у минулих листах, вловлює тон, стиль і вибір слів, а потім автоматично генерує відповідь.

Результат вражає деталізацією. AI враховує такі нюанси, як час у дорозі не більше 5 годин на день, і використовує улюблений прикметник автора "захоплюючий". Лист виходить не просто корисним — він звучить так, ніби його писала жива людина, яка дійсно була в тих місцях.

Це не просто автозаповнення — це справжня персоналізація. AI вивчає ваш стиль спілкування, улюблені фрази, типові реакції та створює контент, який справді звучить як ви.

Функція з'явиться в Gmail цього літа для підписників, але принцип персонального контексту поширюватиметься на всі продукти Google. З вашого дозволу моделі Gemini зможуть використовувати релевантний контекст ваших додатків Google, зберігаючи конфіденційність, прозорість і повний контроль над процесом.

Це кардинально змінює підхід до продуктивності. Замість витрачання часу на написання стандартних листів, складання планів поїздок чи пошук інформації в старих документах, ви просто описуєте, що потрібно, а AI робить решту у вашому стилі.

Важливий нюанс — контроль залишається за користувачем. Ви можете під'єднатися або відключитися в будь-який момент, вибрати, які документи та листи може аналізувати система, і завжди редагувати згенерований контент перед відправленням.

Для бізнесу це означає революцію у комунікаціях. Керівники зможуть делегувати AI написання листів, відповідей на запити та навіть складання звітів, зберігаючи свій стиль і підхід. Персональні асистенти стануть справді персональними.

Нові моделі Gemini

Gemini 2.5 Flash працює в 10 разів швидше попередніх версій, коштує дешевше для розробників і водночас обганяє конкурентів по більшості завдань.

Gemini 2.5 Pro зараз лідирує на LMArena у всіх категоріях. Це не просто маркетингова заява — незалежна платформа, де розробники тестують AI-моделі в реальних умовах. Flash займає друге місце після Pro в рейтингу El Merino, що неймовірно для "легкої" версії.

Покращені ключові показники з міркувань, коду та роботи з великими обсягами тексту. Flash стає загальнодоступним на початку червня, а Pro — незабаром після цього.

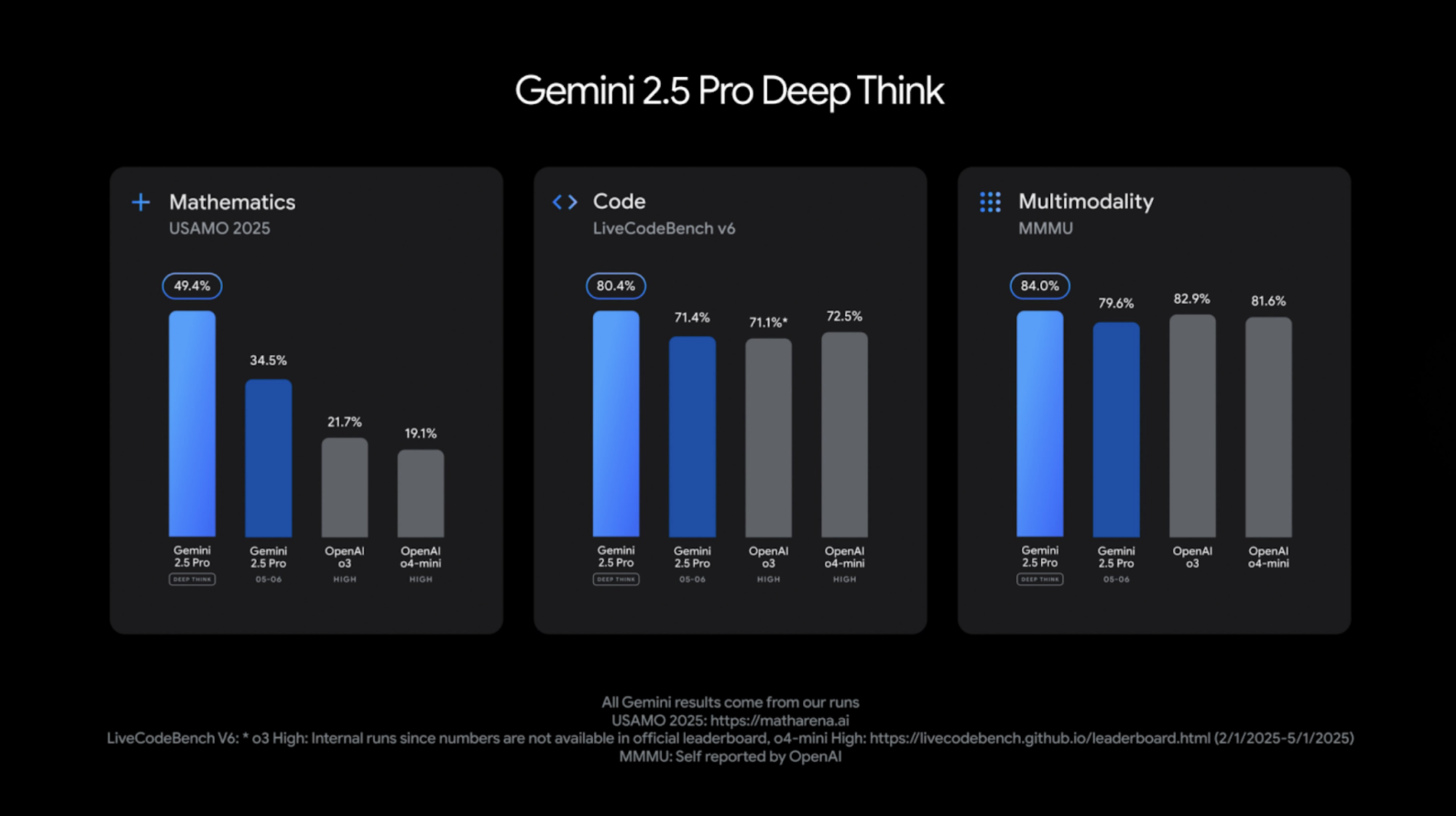

Але справжній прорив — режим DeepThink. Google розширив можливості мислення в Gemini 2.5, додавши новий режим, який дозволяє моделям працювати на межі можливостей. Як каже компанія, з досвіду AlphaGo відомо: відповіді стають кращими, коли модели отримують більше часу на роздуми.

DeepThink використовує найновіші дослідження в області мислення та міркувань, включно з паралельними методами. Результати вражають: модель показує вражаючі результати в UseML 2025 — одному з найскладніших математичних тестів. Лідирує в LiveCodeBench — складному тесті для програмування на професійному рівні.

Оскільки Gemini спочатку була мультимодальною, неймовірно, що вона також показує відмінні результати в основних тестах мультимодальності.

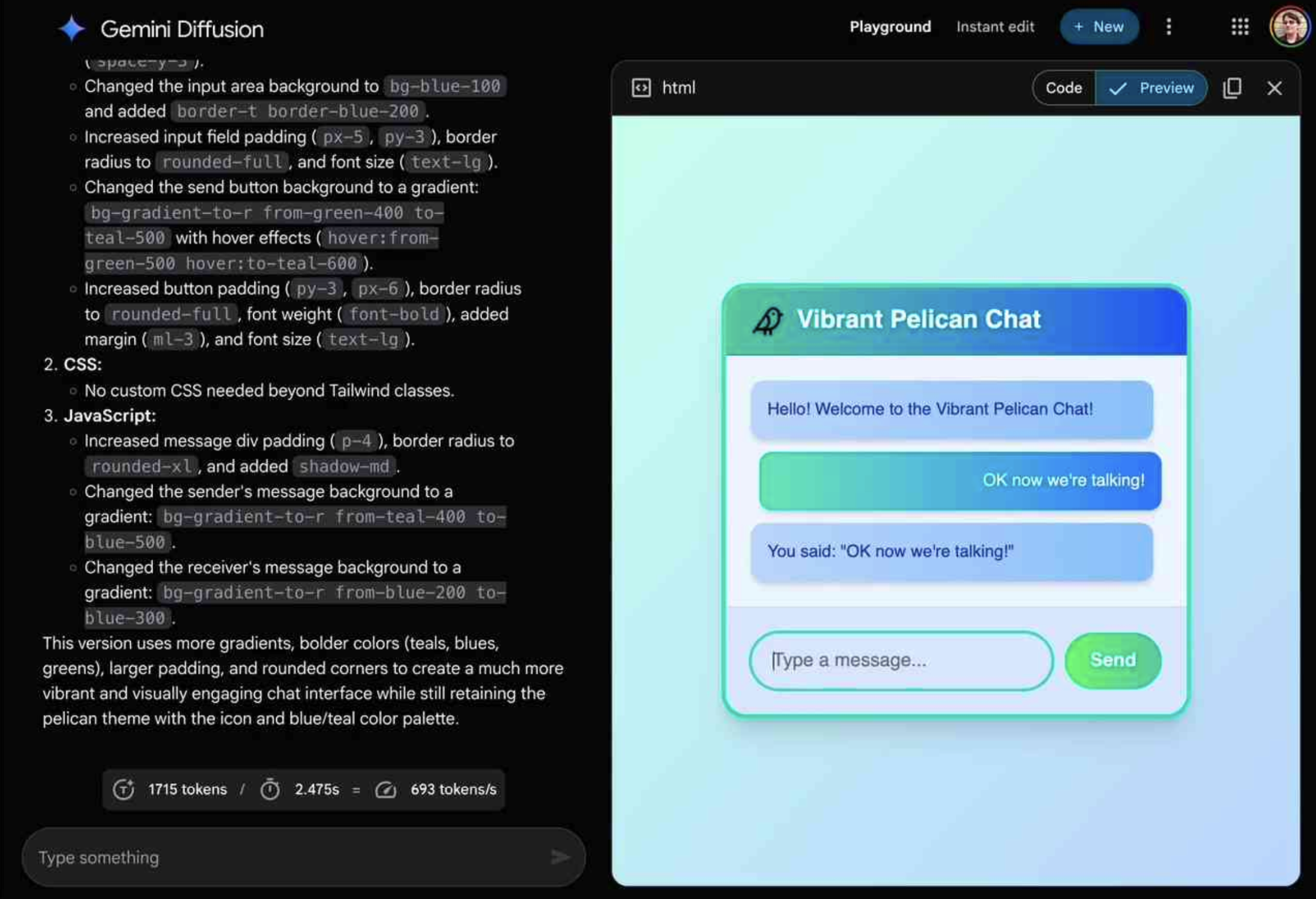

Найнесподіванішою новинкою стала Gemini Diffusion — експеримент, де Google застосовує популярні в генерації зображень методи дифузії до тексту та коду. Замість почергового дописування токенів модель відразу обробляє всю послідовність, поступово перетворюючи шум на осмислену відповідь.

Швидкість зросла в п'ять разів порівняно з найшвидшим Flash. У перспективі це може знизити затримки в чатах до людського рівня реакції.

Google підкреслює безпеку нових моделей. DeepThink проходить додаткову оцінку безпеки та отримує відгуки експертів. У рамках цього надається доступ до моделі через API Gemini довіреним тестувальникам для збору зворотного зв'язку.

Це лише початок AI-революції від Google

Про всі найцікавіші технологічні новинки та їх практичне застосування читайте в моєму Instagram @slavareklama. Там ділюся інсайдерською інформацією про AI, аналізую найгарячіші оновлення від техгігантів та пояснюю, як нові технології змінюють бізнес і повсякденне життя.